生成AIによるネットワーク構築・運用支援実験 : ShowNet 2025

Interop Tokyo ShowNet 2025では、生成AIによるネットワーク構築・運用支援実験が行われています。 Shownetの構築支援に特化したLLM ChatbotがInterop Tokyo 2025のために作成されています。

まずは、ShowNetのLLM Chatbotがどのように使えるのかの動画をご覧ください。

このChatbotは、昨年(2024年)のShowNetの機器のconfigと今年の設計資料を検索し参照(RAG/Retrieval Augmented Generation、検索拡張生成)、幕張メッセ内で稼働するShowNetの機器にAIが直接アクセスしてCLIを操作、ShowNetで運用されているTTDB(Trouble Ticket Database)のチケット情報を参照する機能が実装されています。 また、ShowNet 2025におけるバックボーンのルータ間の接続関係をある程度把握しており、必要に応じてその情報を利用できるように設定されています。

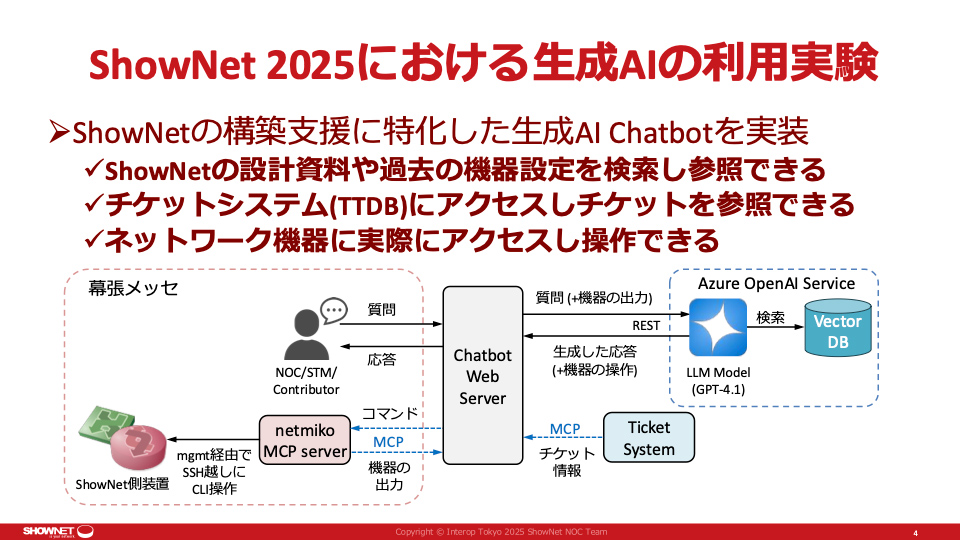

ShowNet 2025のLLM Chatbotは、以下の図のような構成です。

ユーザからの入力を受け付けるのがChatbot web serverです。 このChatbot web serverは、chainlitというossソフトウェアが使われています。 Chatbot web serverは、受け付けた質問をAzure OpenAI Serviceへと送信します。 Azure OpenAI Serviceで利用されているLLM ModelはGPT-4.1です。

Azure OpenAI ServiceのVector DBには、今年のShowNetに関する設計資料や、過去の機器configurationが保存してあり、GPT-4.1は必要に応じてVector DBを利用します。 質問の内容によっては、GPT-4.1がShowNet機器の設定や、TTDBに含まれる情報を参照します。

ShowNet内の情報を参照するための機能は、MCP(Model Context Protocol)を利用して行われます。 MCPでは、モデルが何らかの操作や情報取得を行えるような拡張を行うためにToolsと呼ばれる関数を追加できるようになっています。 今回は、ShowNet内の機器に対してCLIを叩くためのToolsと、TTDBから情報を取得するToolsが作られました。 ShowNet内の機器から情報を取得するnetmiko serverは、ossとして公開されています(https://github.com/upa/mcp-netmiko-server)。 mcp-netmiko-serverは、sshでネットワーク機器に対してコマンドを実行できるPythonのnetmikoライブラリを利用しています。

どのようなコマンドをネットワーク機器に対して送るのかに関しては、GPT-4.1が独自に判断しています。 今回、機器ごとにどのようなコマンドが存在しているのかなどの情報を特別にGPT-4.1に渡しているわけではありません。 GPT-4.1が機器に応じて適切なコマンドを判断してMCPで送っている形です。 なお、ShowNet 2025では、ネットワーク機器の設定を変更するようなコマンドは実行できないようにしてあるため、CLIで実行されるコマンドは機器から情報を得るような内容のみにしてあるとのことでした。

この実験では、利用者が役に立ったのかどうかを評価するという仕組みになっています。 LLM Chatbotがネットワーク管理者にとってどのように使えるのかを、実際に作って、使って、評価するという実験です。 この実験の結果は、松江で7月に行われるJANOG56セッションで報告および議論されるそうなので、ご興味のある方は、ぜひJANOGのセッション(LLMでネットワーク構築運用支援実験@Interop Tokyo 2025 ShowNet)もご覧ください。

最近のエントリ

- ShowNet 2025のルーティングをざっくり紹介

- RoCEとUltra Ethernetの検証:ShowNet 2025

- ソフトルータ推進委員会のスタンプラリー

- 800G関連の楽しい雑談@Interop Tokyo 2025

- VXLAN Group Based Policyを利用したマネージメントセグメント

- ShowNet伝送2025

過去記事