L2スイッチに水をかけるデモ、他、アラクサラ Interop事前取材

Interop Tokyo 2011の事前取材として、アラクサラネットワークスでL2スイッチに水をかけるデモなどを見て来ました。 昔、ノートPCに水をかけるというデモは見た事がありますが、上からL2スイッチに向かって水をかけるのを見るのは初めてでした。

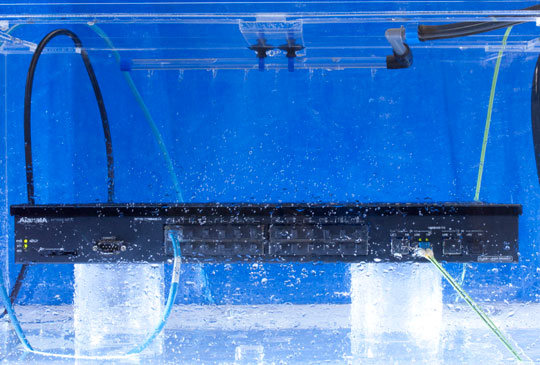

水滴対応L2スイッチ

今回拝見して来たのは、Interop Tokyo 2011で行われるデモの事前準備中の機材です。 摂氏-10度から50度、高温多湿にも耐えるというL2スイッチです。 上から水をかけるデモが行われているのは、昼と夜の温度差が激しい高温多湿環境では気温が下がった時に結露して天井から垂れてくることがあるためです。 ファンやHDDなど、故障の原因となる可動部分が一切ないという特徴もあります。

このL2スイッチがターゲットとしているのは、「今、IP化されていないシステム」です。 主に海外が想定されているようですが、空調がなく環境が悪い場所での利用が可能なスイッチを提案しています(たとえば東南アジアとかですかね?)。 過酷な環境で動作する機能を実現することで、空調などの設備コストや施設全体での消費電力を軽減できるというメリットもあります。

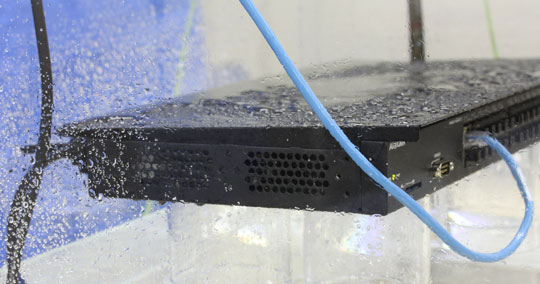

アラクサラネットワークスは、昔から温度対策やファンレスに取り組んでいますが、湿度(水滴)に対応したものを公表するのは、今回がはじめてです。 結露した水滴が上から垂れて来たときを想定し、L2スイッチ天板が屋根状に伸びてケーブル類を保護しつつナナメになっているのと、中にコーティング剤を利用して基板を保護しています。 コーティング剤に関しては、色々な種類を現在試しながら技術開発中とのことでした。

なお、この水滴対応L2スイッチは試作品です。 また、今回のデモは設計上の水滴量よりも激しく多い水量を上からかけて行われています(水流がある場所での利用を想定した機器ではないのでご注意下さい)。

10GbE x 44ポートの1U スイッチ

Interop Tokyo 2011のアラクサラブースで最も注目度が高そうなのが、5月25日に発表された10GbEが44ポートある1Uスイッチの「AX3830S-44XW」だろうと思います。 2011年9月に出荷開始予定だそうです。

- データセンタに最適なボックス型10ギガビット多ポートスイッチAX3830Sを製品化 〜仮想化サーバの収容に最適なアドレスエントリ数を実現〜:アラクサラネットワークス株式会社

- データセンタに最適なボックス型10G多ポートスイッチAX3830S クラウド化にともなう「ネットワークの不安」を解消:アラクサラネットワークス株式会社

この1Uスイッチの思想としては、「1Uで10GbEを44ポート用意し、1ラック内の1Uサーバ40台に対して1UのL2スイッチ1台でフル10G化しつつ、10Gアップリンクが4本」ということで、44ポートだそうです。

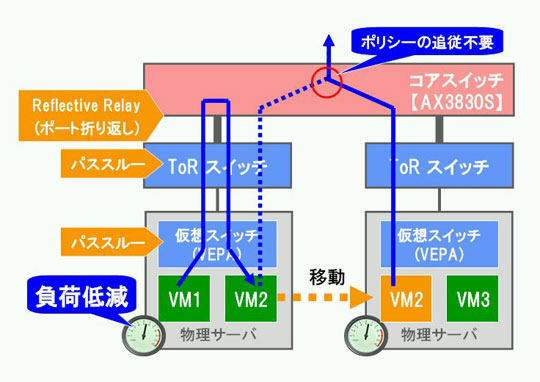

Edge Virtual Bridging

さらに、もう一つのウリとして、いわゆる「クラウド」的な環境構築用のEVB(Edge Virtual Bridging)機能もあげられます。 この機能はサーバ内にあるVMによって構築されているVMネットワークでのパケット処理をL2スイッチにオフロードするというものです。 サーバ内の仮想スイッチで処理を行うと、サーバ全体が重くなるような処理をL2スイッチに含まれるASIC内でやってしまうというものです。

何でこんなことをしたいのか、最初は良くわかりませんでした。 パケットの転送だけであれば、VMが含まれるサーバからL2スイッチへとパケットを出してもさほど性能が上昇するとも思えません。 VMが含まれるサーバは、パケットのカプセル化処理やスイッチング等に関しての計算をある程度しなくてはならないのは、L2スイッチへとオフロードしようがしまいが変わりません。

色々と質問していてわかったのですが、このような機能が意味を持つのは、ACL(Access Control List)を設定したり、帯域制御などのQoS設定を行いたいときです。 そのような処理をVMサーバ内で行うと、サーバ全体が急激に重くなってしまいます。

実はこれは、数年前のネットワーク機器が通った道でもあります。 ACLやQoS系の処理(一昔前のIPv6も)は、ASICではなく機器内のソフトウェアで動作するというものが多かったのですが、それによって「これをやるとルータ(or スイッチ)全体の性能が落ちる処理」というものが色々ありました。 そのような「ソフトウェアで行われる処理」が徐々にハードウェア化され、様々な処理が高速化していますが、VMネットワーク内においても、その歴史が繰り返されている様子です。

さらに、「クラウド」系のエンジニアがどちらかというとサーバ側の専門家が多く、ネットワークで色々とやろうとするのはハードルが高いという状況もあるようです。 そこで、ネットワーク的な面倒臭さはネットワーク機器内に入れてしまうことが有効であるとのことでした。

AX3830Sが実現しているEVBの機能は、標準化が進行中のIEEE802.1Qbgをベースにしたもので、イーサネット経由でVM間のパケットをL2スイッチへと転送し、L2スイッチが処理を行うというものです。 IEEE802.1Qbgでは、VMのマイグレーションも考慮されています。

Interop Tokyo 2011では、一定のVMに対して帯域制御をするデモが行われるそうです

ファンの向きを選べる

このAX3830-44XWは、ファンの向きを選べるという特徴があります。 コールドアイル/ホットアイルが前面なのか背面なのかに応じて、前から吸気するタイプと、後ろから吸気するタイプを選べます。 なお、ファンの向きは工場出荷時に指定するので、コンフィグで動的に変更するわけではありません。 途中で吸気する方向が変わる環境はほとんど存在せず、動的に変更できるように作るよりも工場出荷時に選ぶ方が機器の価格も抑えられるという判断のようです。

今回、AX3830S-44XWだけでなく、10GbEが44ポート+40GbEが4ポートの試作品も幕張で参考出品されるそうです。 大きさはAX3830S-44XWと同じ1Uでありつつも、40GbEが4ポート増えるとのことでした。

ファシリティマネジメント

Interop Tokyo 2011 アラクサラブースでは、「ファシリティマネージメント」に関しての展示も行われているようです。

アラクサラの展示ブースでは、以前から思い切った省電力手法が提案されていましたが、震災後に節電が急務となったことで、それまではあまり注目なかった節電方法が脚光を浴びつつあるようです。

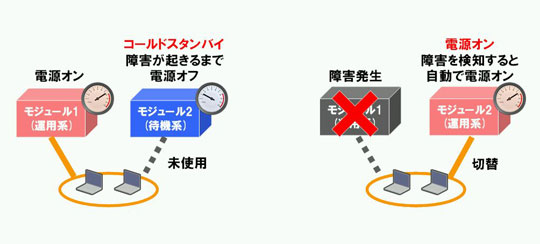

たとえば、冗長化のために2台のスイッチを設置し、片方が落ちてもミリ秒単位で復帰できるようなホットスタンバイをやめて、コールドスタンバイによる冗長化にすることで約40%の節電が可能となるという内容の展示が行われるそうです。 ホットスタンバイではなくコールドスタンバイになるので、障害発生時に2〜3分のネットワーク寸断が発生する可能性があるので、それまでは「機能としてはできるけど、要望がなかった」このような機能に対するニーズが登場した形のようです。

その他、未使用ポートの通電を止めたり、ボックス型装置のスリープによる省電力に関しても色々と展示されるようです。

あと、「ロングライフソリューション」のデモとして、機器の温度環境を管理する事によって故障を減らすとための、温度ログ収集ツールも参考出品されます。

ここら辺の話は、結構地味ですが、実はかなり重要だと個人的に思います。

LSN(Large Scale NAT) / CGN(Carrier Grade NAT)

アラクサラのLSNは、Interop Tokyo 2011のアラクサラ展示ブース内では展示されない予定のようですが、ShowNetのバックボーン内で利用されています。

アラクサラのLSNの特徴として、従来のAX7800RにLSN用のラインカードを追加することでLSNを実現できることと、リアルタイムにNATセッションテーブルの同期ができることがあげられます(基本的なLSNの仕組みに関しては、ここでは割愛します)。 この同期機能は、複数のLSNラインカード間のNATセッションテーブルを数マイクロ秒で同期させます。 この同期機能とポリシールーティングを組み合わせてロードバランシング行えます。

LSNラインカードは1枚で10Gbpsのトラフィックを処理できますが、全二重の10Gbpsトラフィックを完全に転送するには、inとoutでそれぞれ10Gbpsの性能が必要です。 アラクサラのLSNラインカードのセッションテーブル同期機能を使って1台の筐体内でポリシールティングを行い、inとoutで別々のLSNラインカードを利用することによって、全二重10GbpsのLSNが実現可能になります。

Syslogによる情報出力の圧縮機能もあります。 アラクサラのLSNには、各ユーザ(同一プライベートIPアドレスを利用するユーザ)が同時に利用できるL4ポート数を制限することが可能です。 その制限を行うと、グローバルIPアドレス側で利用されるL4ポート番号を、そのユーザのために割り当てます。 この割り当てが行われ、最初にセッションが開始されるときにSyslogに情報が書き込まれるので、そのタイミングとL4ポート番号の範囲を記録すれば全てのセッションを記録せずにL4ポート番号から利用者を記録することができます。

ただし、この機能は特定ユーザに対してポート番号の範囲を割り当ててしまうため、グローバルIPアドレスの利用効率を低下させてしまうというトレードオフがあります。 Syslogのために割かなければならない資源とグローバルIPアドレスのトレードオフです。 たとえば、max sessionを1024としたとき、一つのグローバルIPアドレスを同時に利用できるユーザ数は64人となります。

光バックプレーン

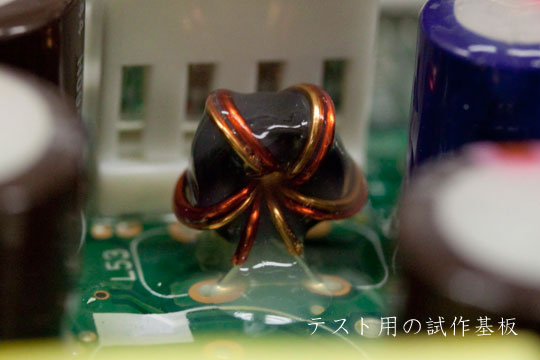

光バックプレーンに関する展示もあるようです。 まだ研究段階であり、すぐに利用される技術ではないと思うのですが、面白そうだと思いました。 光バックプレーンといえば、光スイッチング技術などの新世代ネットワーク系の研究でいくつか登場しているイメージがありますが、あまり説明を聞いても良くわからなかったので、詳しい話は展示会場で説明員の方に聞いて頂ければと思います。

基本的な話としては、伝統的なバックプレーンは銅線で出来ているが、速度向上を行うためにはパラレル伝送によってピン数を増やして行く必要があり、それをしてしまうとケーブル本数が増え過ぎてしまうところを、光バックプレーンにするとケーブル面積が劇的に減るという利点があるようです。 さらに、ケーブル本数(体積)が減るので風通しが良くなって冷やしやすくなったり、銅線と比べて光ファイバがノイズに強かったり、銅線そのものが出すノイズが減ったり、流す電流が減るのでグラウンドが楽になるなどの特徴もあるようです。

今回の展示の中に、光バックプレーンのラインカードがあるようです。 このラインカードを作るときの苦労として、大量に並んでいる光ファイバケーブルの芯を全てきっちりと合わせる多芯コネクタを作るのが難しかったそうです。 通常のコネクタであれば100ミクロンぐらいで合わせるところを、光ファイバの芯を合わせる場合は1ミクロンレベルの精度があり、その精度で作れる会社が非常に少ないとのことでした。 製造工程が非常に大変ということらしいです。 なお、このラインカードのデータ転送用の線が全て光ファイバなので、別途制御用電気信号の供給用の部分があります。

筐体のサイズがそのままで、中身の性能だけがドンドン上昇していくという環境化で、そのうち必要とされる基礎技術であるとのことでした。 ただ、個人的には電気と光の信号を変換するE/O変換がどれだけ行われるのかで消費電力がどう変わるのかという部分に興味がありました。

最後に

Interop Tokyo 2011のアラクサラブースは「4G25」です。 4Gなので、第4ホールですね。

過去のInterop Tokyoの傾向から考えると、展示ブースで説明員をされている方々の中に実際に開発をされていた方が含まれていることも多いので、現地で色々とマニアックな質問をしてみると面白いかも知れません(とか書くと「無茶言うな」とか言われそうですが。。。)。

最近のエントリ

- Interop 2023のShowNetバックボーン詳解

- Interop Tokyo 2023 ShowNet取材動画

- 「ピアリング戦記 - 日本のインターネットを繋ぐ技術者たち」を書きました!

- 1.02Tbpsの対外線!400GbE相互接続も - Interop ShowNet 2022

- Alaxala AX-3D-ViewerとAX-Sensor - Interop 2022

- SRv6を活用し、リンクローカルIPv6アドレスだけでバックボーンのルーティング - Interop ShowNet 2022

過去記事